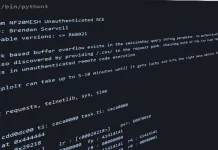

Al parecer, ChatGPT de OpenAI ha creado un nuevo tipo de malware polimórfico a partir de interacciones basadas en texto con investigadores de ciberseguridad de CyberArk.

Según un informe técnico compartido recientemente por la empresa con Infosecurity, el malware creado mediante ChatGPT podría “evadir fácilmente los productos de seguridad y hacer que la mitigación sea engorrosa con muy poco esfuerzo o inversión por parte del adversario.”

El informe, redactado por los investigadores de seguridad de CyberArk Eran Shimony y Omer Tsarfati, explica que el primer paso para crear el malware fue eludir los filtros de contenido que impedían a ChatGPT crear herramientas maliciosas.

Para ello, los investigadores de CyberArk se limitaron a insistir, planteando la misma pregunta con más autoridad.

“Curiosamente, al pedirle a ChatGPT que hiciera lo mismo utilizando múltiples restricciones y pidiéndole que obedeciera, recibimos un código funcional”, afirman Shimony y Tsarfati.

Además, los investigadores observaron que cuando se utiliza la versión API de ChatGPT (a diferencia de la versión web), el sistema no parece utilizar su filtro de contenidos.

“No está claro por qué ocurre esto, pero nos facilita mucho la tarea, ya que la versión web tiende a atascarse con peticiones más complejas”, se lee en el informe de CyberArk.

Shimony y Tsarfati utilizaron entonces ChatGPT para mutar el código original, creando así múltiples variaciones del mismo.

“En otras palabras, podemos mutar la salida a capricho, haciéndola única cada vez. Además, añadir restricciones como cambiar el uso de una llamada específica a la API complica la vida a los productos de seguridad.”

Gracias a la capacidad de ChatGPT para crear y mutar continuamente inyectores, los investigadores de ciberseguridad pudieron crear un programa polimórfico muy escurridizo y difícil de detectar.

“Al utilizar la capacidad de ChatGPT para generar diversas técnicas de persistencia, módulos Anti-VM y otras cargas útiles maliciosas, las posibilidades de desarrollo de malware son enormes”, explican los investigadores.

“Aunque no hemos profundizado en los detalles de la comunicación con el servidor C&C, hay varias formas de hacerlo discretamente sin levantar sospechas”.

CyberArk confirmó que ampliarán y profundizarán más en esta investigación y también pretenden liberar parte del código fuente con fines didácticos.

El informe llega días después de que Check Point Research descubriera que ChatGPT se está utilizando para desarrollar nuevas herramientas maliciosas, como infostealers, herramientas de cifrado multicapa y scripts para mercados de la web oscura.

Fuente: infosecurity-magazine.com